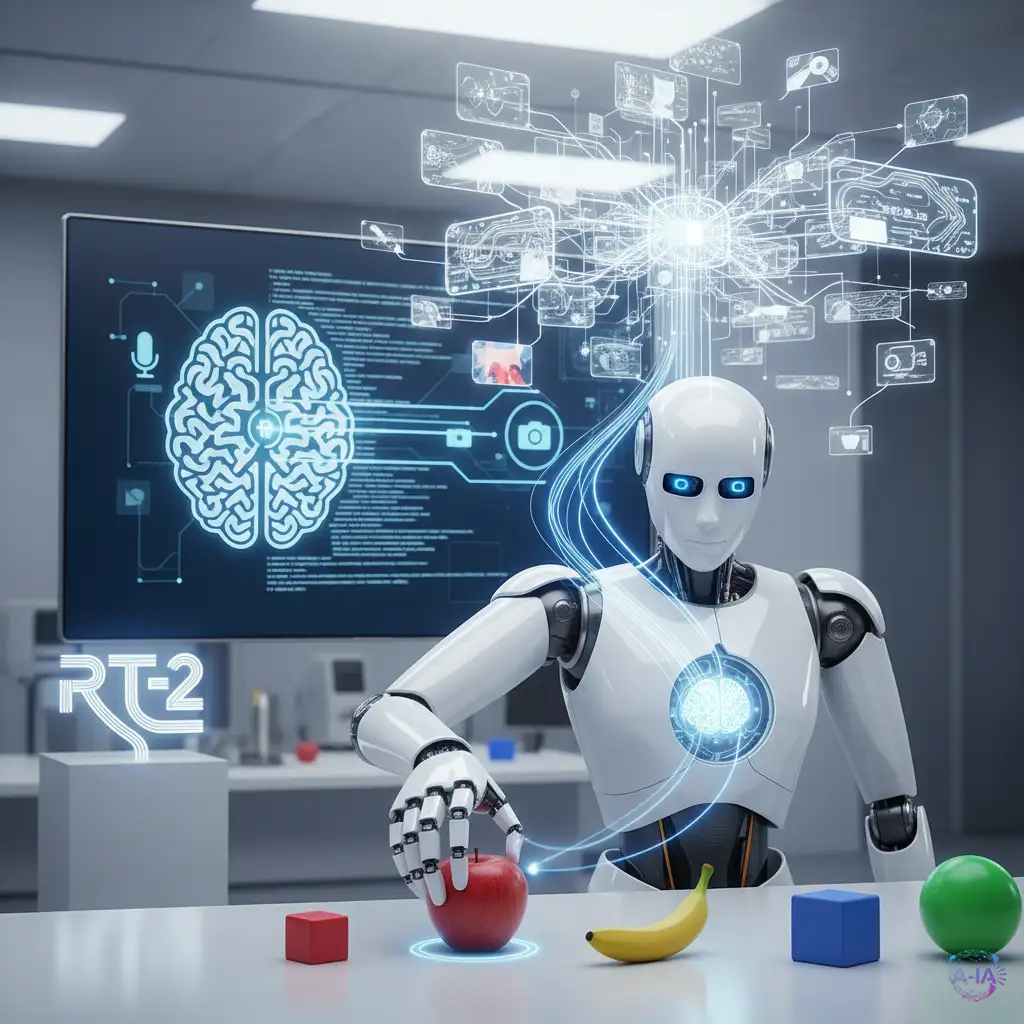

Google DeepMind enseña a los robots a 'pensar' con lenguaje natural usando el modelo RT-2

Google DeepMind ha presentado RT-2, un modelo de IA multimodal que permite a los robots interpretar comandos complejos y generalizar tareas en el mundo real, usando el lenguaje natural como puente entre la visión y la acción.

Google DeepMind ha dado un paso monumental en el campo de la robótica al presentar RT-2 (Robotics Transformer 2). Este no es solo un nuevo robot, sino un nuevo tipo de cerebro de IA diseñado para robots. Por primera vez, los sistemas robóticos están aprovechando el vasto conocimiento de los modelos de lenguaje grande (LLMs), los mismos que impulsan a ChatGPT o Gemini, para interactuar con el mundo físico.

El Salto de la IA Lingüística a la Robótica

Hasta ahora, programar un robot para realizar una tarea, como recoger una taza, requería instrucciones muy específicas y codificadas. Si la taza se movía o cambiaba de color, el robot fallaba. Eran máquinas brillantes pero rígidas.

RT-2 cambia esto. Los investigadores de DeepMind han tomado un modelo de lenguaje y visión, entrenado con billones de datos de texto e imágenes de internet, y lo han adaptado para controlar las acciones de un robot. Esto dota al sistema de una especie de “sentido común” adquirido de la web.

¿Cómo funciona? Si le pides a un robot tradicional que recoja una manzana, sabe cómo hacerlo. Pero si le pides que "recoja el objeto rojo que está en la mesa", podría confundirse. RT-2, al estar entrenado con lenguaje y visión, puede entender que "rojo" y "manzana" son conceptos relacionados, e incluso puede inferir que debe recoger un objeto que no ha visto antes, siempre que cumpla con la descripción.

¿Qué hace a RT-2 tan especial? El poder de la multimodalidad

RT-2 es un modelo multimodal que integra datos visuales (lo que ve el robot) y datos lingüísticos (lo que el robot ha aprendido de internet). Esto le permite:

- Interpretar comandos abstractos: El robot puede entender instrucciones como "pon el objeto en la basura" o "limpia el derrame", tareas que requieren juicio y planificación, no solo movimientos preprogramados.

- Generalizar tareas: Si el robot aprendió a abrir una puerta de un tipo, RT-2 le permite aplicar ese conocimiento para abrir una puerta completamente diferente, una habilidad conocida como generalización.

- Manejar situaciones inesperadas: Si se le pide al robot que recoja una botella, y esta está boca abajo, el modelo puede ajustar su estrategia basándose en su conocimiento adquirido de cómo funcionan los objetos en el mundo real.

Este avance es crucial porque reduce drásticamente la necesidad de programar cada escenario individualmente. En esencia, DeepMind ha creado un sistema que puede ser instruido en lugar de ser codificado.

De la Teoría a la Vida Real: ¿Cuándo veremos estos robots?

El impacto de RT-2 no se limita solo a los laboratorios de DeepMind. Este tipo de arquitectura de IA es fundamental para el desarrollo de la robótica de propósito general. Imagina robots de servicio en hospitales, almacenes o incluso hogares que no necesitan un manual de instrucciones de 100 páginas, sino que responden a peticiones sencillas en lenguaje natural.

Aunque aún estamos lejos de los robots domésticos completamente autónomos que vemos en la ciencia ficción, RT-2 representa un cambio de paradigma: el lenguaje y el conocimiento masivo de la IA se convierten en la clave para desbloquear la verdadera inteligencia física de las máquinas. Los robots están dejando de ser herramientas específicas para convertirse en aprendices versátiles.