Claude llega a Chrome: una beta limitada con preocupaciones de seguridad

Anthropic lanza una versión beta de Claude para Chrome, pero advierte sobre la vulnerabilidad a los ataques de inyección de prompt, un desafío importante en la seguridad de la IA conversacional.

Claude llega a Chrome: una beta limitada con preocupaciones de seguridad

Anthropic ha lanzado una versión beta limitada de su modelo de lenguaje Claude para el navegador Chrome. Si bien esta integración promete facilitar el acceso a las capacidades de Claude, la empresa reconoce que los ataques de inyección de prompt siguen siendo una preocupación importante. Esta noticia destaca la tensión entre la innovación en IA conversacional y las necesidades de seguridad.

La extensión para Chrome permite a los usuarios interactuar con Claude directamente desde su navegador, abriendo nuevas posibilidades para la productividad y la automatización de tareas. Sin embargo, Anthropic advierte explícitamente sobre la vulnerabilidad a los ataques de inyección de prompt, un problema que afecta a muchos modelos de lenguaje grandes (LLMs). Estos ataques ocurren cuando un usuario manipula el prompt o la instrucción inicial para que el modelo genere una respuesta no deseada o incluso maliciosa.

El desafío de la seguridad en la IA conversacional

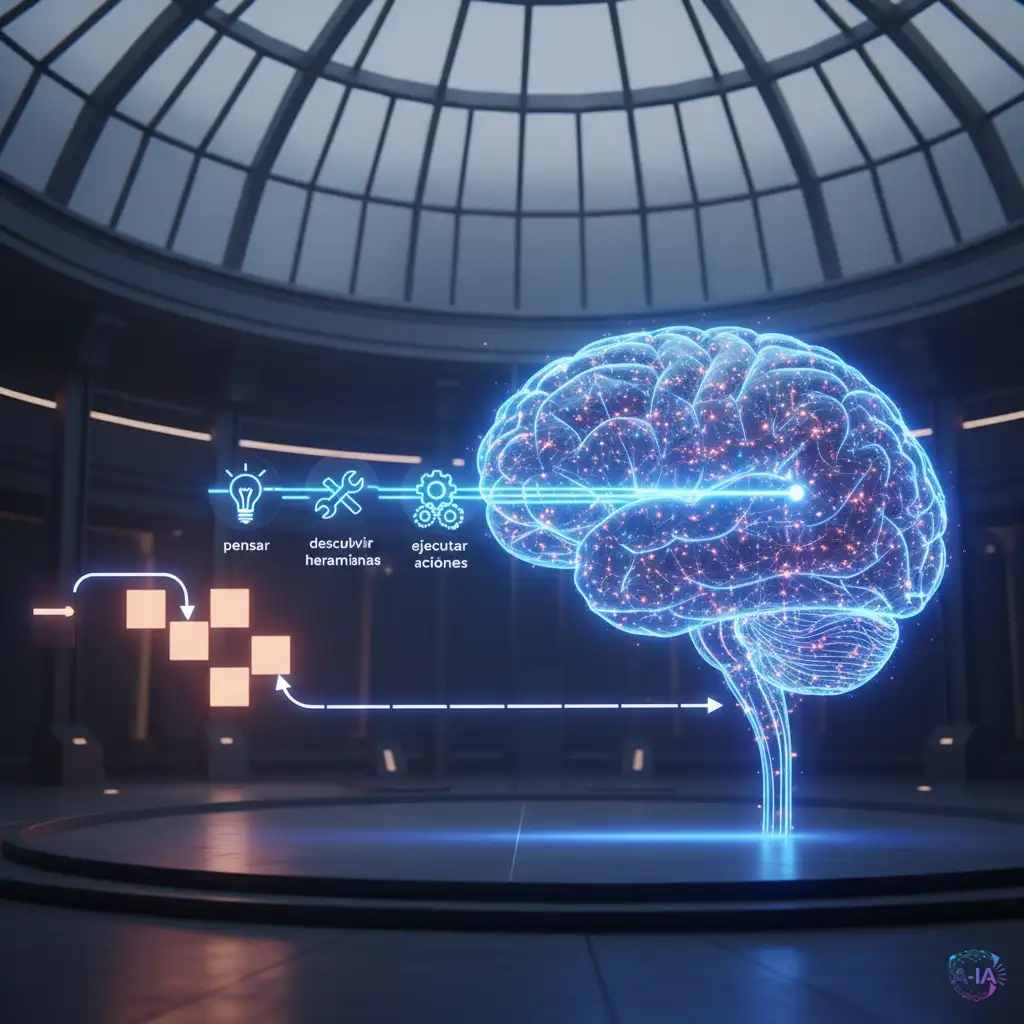

El lanzamiento de Claude para Chrome en una beta limitada refleja un enfoque cauteloso por parte de Anthropic. La empresa prioriza la seguridad y la mitigación de riesgos, incluso si esto significa retrasar un lanzamiento más amplio. Este enfoque es crucial, ya que la integración de modelos de lenguaje en herramientas cotidianas como los navegadores web plantea nuevas preocupaciones de seguridad. A diferencia de las aplicaciones de escritorio, la interfaz del navegador ofrece a los atacantes más puntos de entrada potenciales, amplificando el riesgo de ataques de inyección de prompt y otras vulnerabilidades. Esto genera un dilema complejo: equilibrar la accesibilidad y la utilidad con la seguridad y la prevención del mal uso.

La necesidad de una robusta gestión de riesgos queda patente. La proliferación de modelos de lenguaje de gran tamaño (LLMs) disponibles para el público, y su integración en plataformas de uso masivo, exige una investigación continua y la implementación de estrategias de seguridad más robustas para proteger a los usuarios. Este caso expone la fragilidad de los sistemas de IA incluso en escenarios aparentemente simples como la extensión de un navegador.

El futuro de la integración de LLMs

El lanzamiento de Claude en Chrome representa un paso más en la creciente integración de modelos de lenguaje grandes en nuestra vida diaria. El futuro de esta tecnología se encuentra en el desarrollo de sistemas más robustos y seguros. Para ello, la investigación de la seguridad en IA debe mantener el paso con la velocidad de desarrollo de los modelos. El caso de Anthropic resalta la importancia de abordar los retos de seguridad de forma proactiva, priorizando la mitigación de riesgos antes de la proliferación masiva de estas herramientas. Esta lección nos recuerda que la innovación debe ir siempre acompañada de una gran responsabilidad para prevenir consecuencias negativas.