Llamado a la responsabilidad: Un cofundador de OpenAI exige pruebas de seguridad para modelos rivales

Un cofundador de OpenAI ha pedido a los laboratorios de IA que prueben la seguridad de sus modelos rivales antes de lanzarlos, destacando la necesidad de una evaluación exhaustiva de los riesgos en la creciente carrera por el desarrollo de la IA.

Llamado a la responsabilidad: Un cofundador de OpenAI exige pruebas de seguridad para modelos rivales

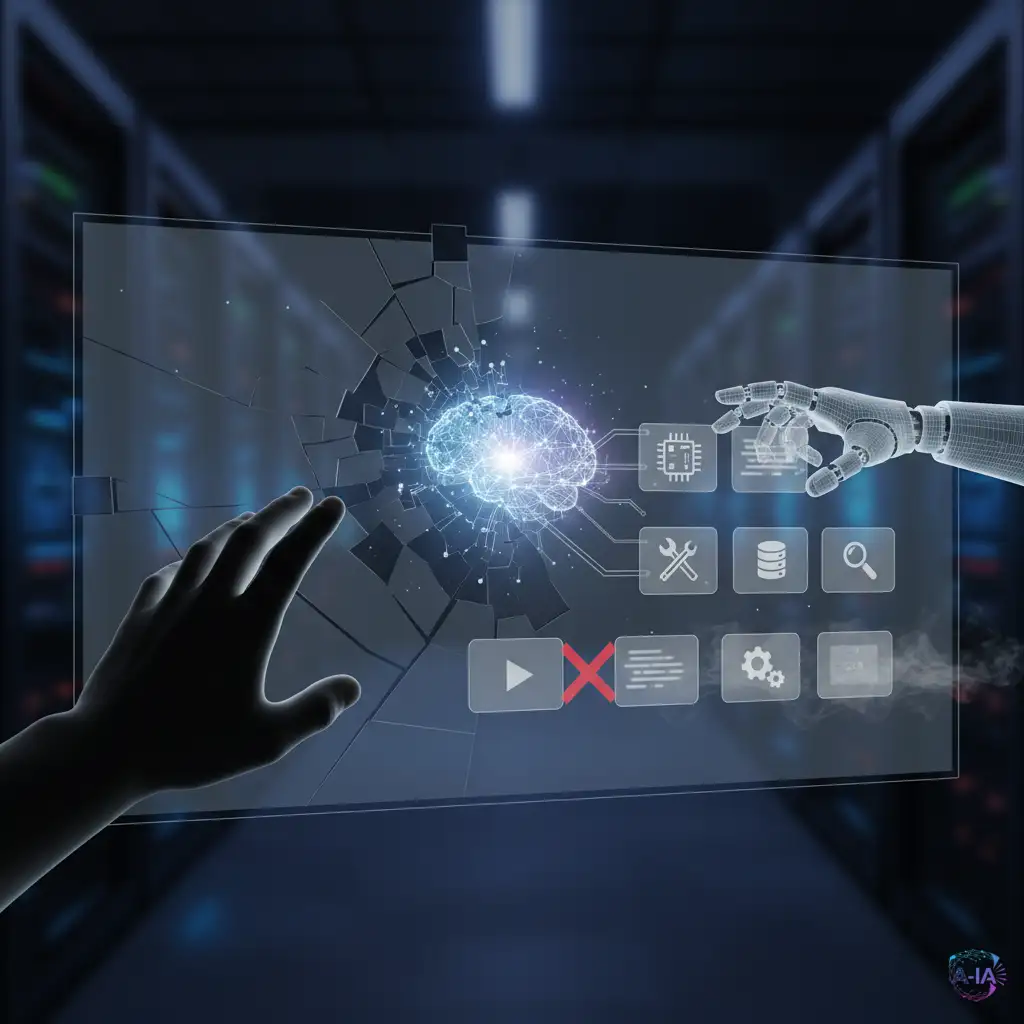

El cofundador de OpenAI, en un giro sorprendente, ha instado a los laboratorios de inteligencia artificial a realizar rigurosas pruebas de seguridad en sus modelos antes de su lanzamiento. Esta petición, que resuena en un sector cada vez más preocupado por el potencial impacto de la IA, marca un hito en el debate sobre la ética y la regulación de la tecnología. La petición se centra en la necesidad de evaluar a fondo los riesgos potenciales de modelos rivales, enfatizando la importancia de la transparencia y la colaboración.

El dilema de la carrera armamentística en IA

La propuesta del cofundador de OpenAI destaca un aspecto preocupante: la creciente carrera entre grandes empresas tecnológicas por desarrollar modelos de IA cada vez más potentes. En este contexto, la prioridad de alcanzar hitos tecnológicos puede eclipsar la necesidad de una evaluación exhaustiva de las implicaciones éticas y de seguridad. La falta de regulación sólida y la ausencia de protocolos de seguridad estandarizados generan un vacío que podría tener consecuencias imprevistas.

Los modelos de IA avanzados, como GPT-5 y Llama 3, se están volviendo cada vez más sofisticados. Su capacidad para generar texto, traducir idiomas y responder preguntas con fluidez se ha incrementado exponencialmente, presentando grandes posibilidades y al mismo tiempo preocupaciones importantes. La falta de estandarización en las pruebas de seguridad hace difícil la comparación entre modelos y la evaluación de su verdadera solidez. Además, la falta de transparencia en el desarrollo y la poca participación de especialistas independientes añade complejidad a la cuestión.

La necesidad de colaboración y regulación

El llamado del cofundador de OpenAI no es solo una advertencia, sino también una propuesta de colaboración para el desarrollo responsable de la IA. La implementación de protocolos estandarizados y un mayor compromiso con la seguridad son cruciales. No se trata de frenar la innovación, sino de encaminarla por un sendero más seguro y ético. La industria tecnológica debe unirse para elaborar estándares robustos que reduzcan el riesgo de usos malintencionados y mitiguen los posibles problemas.

La discusión no se limita al ámbito privado, ya que la intervención de los reguladores es esencial para establecer un marco legal que proteja a los ciudadanos y garantice el desarrollo responsable de la IA. El debate sobre la regulación de la inteligencia artificial está más vivo que nunca y este evento marca una etapa clave en el proceso de configuración de un futuro con IA donde la seguridad y la ética sean prioridades indiscutibles.