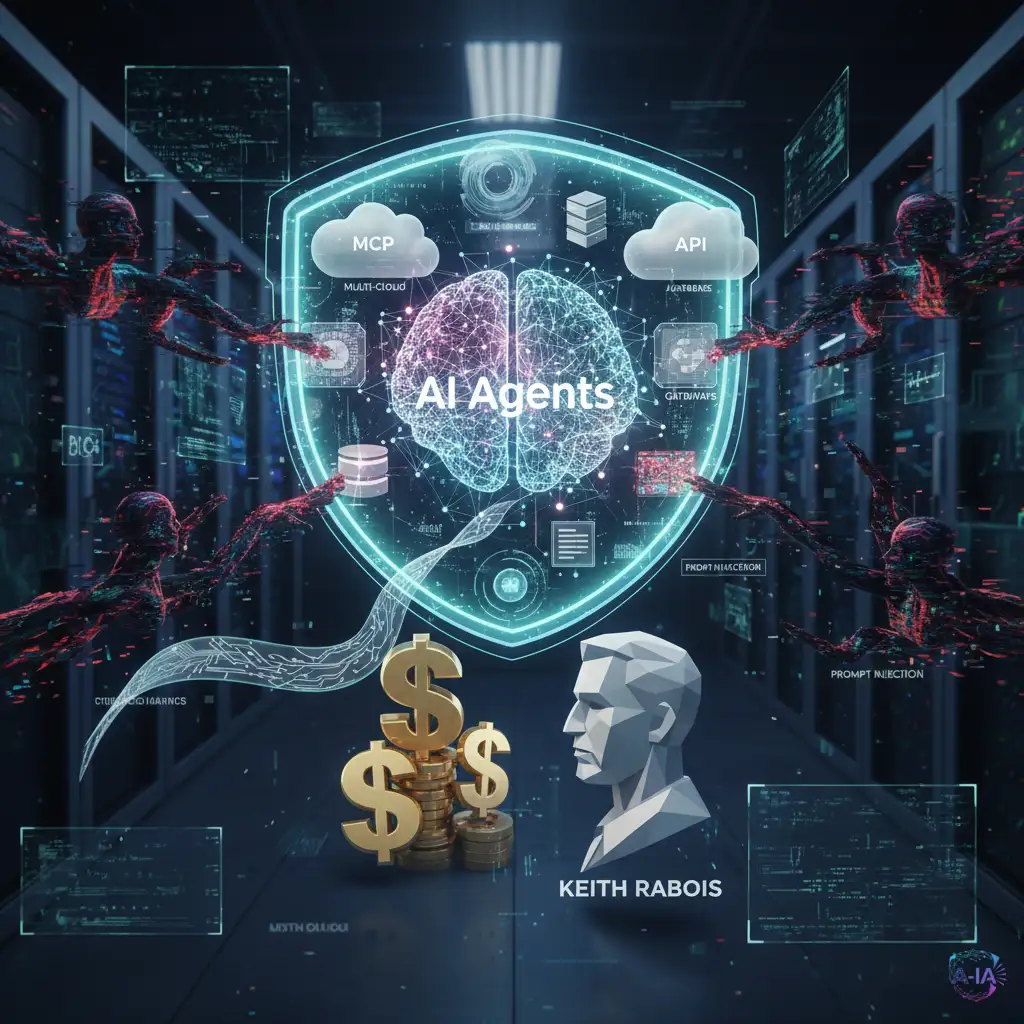

Runlayer lanza una plataforma de seguridad clave para Agentes de IA y recauda $11 millones con Keith Rabois

La startup Runlayer ha lanzado oficialmente su plataforma de seguridad dedicada a proteger a los agentes de Inteligencia Artificial que operan en entornos multi-nube, asegurando una financiación inicial de $11 millones liderada por Keith Rabois de Khosla Ventures y Felicis.

La promesa de la Inteligencia Artificial no reside solo en los grandes modelos de lenguaje (LLMs) como GPT-4, sino en los Agentes de IA: sistemas autónomos capaces de tomar decisiones, ejecutar tareas complejas y operar sin supervisión constante. Sin embargo, esta autonomía masiva trae consigo un riesgo de seguridad igualmente grande. Aquí es donde entra Runlayer.

La startup, que acaba de salir del modo sigiloso (stealth) con una ronda de financiación de 11 millones de dólares, se enfoca en ser el "cinturón de seguridad" para esta nueva generación de software, asegurando que los agentes no se vuelvan maliciosos, expongan datos sensibles o cometan errores costosos mientras navegan por la infraestructura de una empresa.

El Desafío de los Agentes Autónomos

Imagina que has delegado a un agente de IA la tarea de gestionar todas las finanzas de tu empresa, desde pagar facturas hasta negociar contratos. Este agente no solo interactúa con un único sistema, sino que debe moverse entre diferentes plataformas en la nube (lo que se conoce como entornos multi-nube o MCP), bases de datos y APIs externas.

El problema es que, a medida que los agentes obtienen más permisos para actuar, también se convierten en un objetivo atractivo para los ciberdelincuentes. Un simple ataque de "inyección de prompt" podría engañar a un agente para que realice acciones no autorizadas, como transferir fondos o eliminar información crítica.

La seguridad tradicional no está diseñada para este tipo de software. Necesitas una capa que entienda la intención del agente y monitoree cada paso de su lógica, no solo su código base. Runlayer busca llenar este vacío crucial.

Runlayer: El "Guardián" de la Ejecución

Runlayer ha desarrollado una plataforma que actúa como un guardián de la ejecución para los agentes de IA. Su tecnología se centra en proporcionar una visibilidad profunda de las interacciones de los agentes, permitiendo a las empresas establecer límites claros y políticas de seguridad.

Esto incluye:

- Prevención de Fugas de Datos: Asegurando que los agentes no expongan inadvertidamente información confidencial al interactuar con modelos externos o bases de datos.

- Control de Acceso Riguroso: Limitando las acciones que un agente puede tomar, incluso si ha sido comprometido o ha recibido instrucciones maliciosas.

- Monitoreo en Tiempo Real: Detectando patrones de comportamiento anómalos que puedan indicar que el agente ha sido subvertido.

Al centrarse en el flujo de trabajo y la lógica del agente, Runlayer ofrece una protección que va más allá de los cortafuegos y antivirus tradicionales, adaptándose a la complejidad de los sistemas autónomos modernos.

Respaldo de Inversores de Alto Nivel

La confianza en la necesidad de esta tecnología se refleja en su exitosa ronda de financiación de 11 millones de dólares. La inversión fue liderada por figuras prominentes del capital de riesgo como Keith Rabois de Khosla Ventures y la firma Felicis.

Rabois, conocido por su ojo para las empresas disruptivas, ve en Runlayer un componente fundamental para la adopción masiva de agentes de IA en el mundo empresarial. Además del capital, Runlayer ya cuenta con una tracción impresionante, trabajando con ocho "unicornios" (empresas valoradas en más de mil millones de dólares) que ya están implementando agentes de IA y necesitan asegurar sus operaciones desde el día uno.

Este lanzamiento subraya una tendencia clara: a medida que la IA se vuelve más poderosa y autónoma, la infraestructura de seguridad dedicada a controlarla y protegerla se convierte en un mercado multimillonario esencial, pasando de ser un lujo a una necesidad básica para cualquier empresa que quiera delegar tareas críticas a la inteligencia artificial.