Google abre la caja secreta: Venderá sus chips de IA (TPUs) para desafiar el dominio de Nvidia

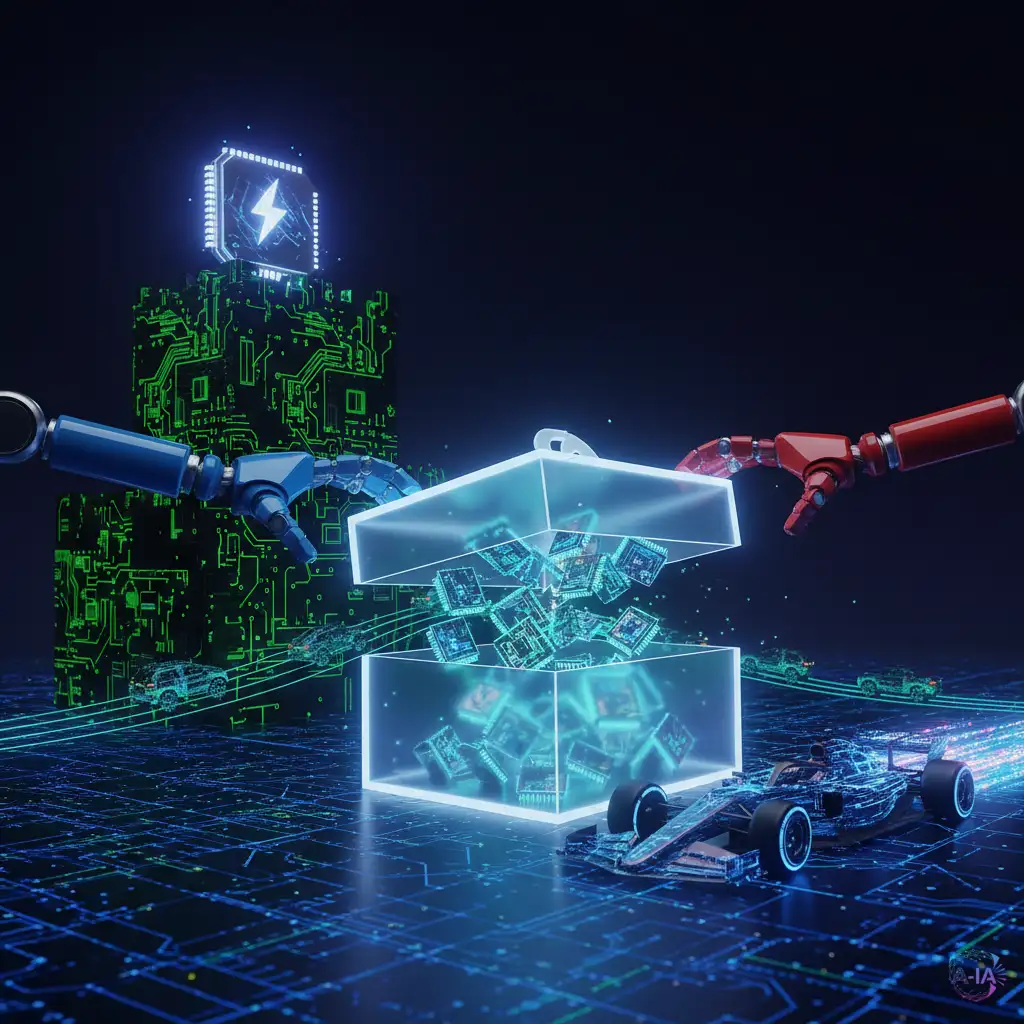

Google está negociando vender sus unidades de procesamiento tensorial (TPUs), chips diseñados específicamente para acelerar la IA, a otras empresas tecnológicas, lo que representa una competencia directa y significativa para el dominio de Nvidia en el mercado de hardware de inteligencia artificial.

El hardware es la base de la revolución de la Inteligencia Artificial, y hasta ahora, una compañía ha gobernado este reino: Nvidia. Sus GPUs (Unidades de Procesamiento Gráfico) son el estándar de oro para entrenar modelos gigantescos como GPT-4. Sin embargo, Google, que ha estado desarrollando su propia tecnología de chips en secreto durante años, está a punto de cambiar las reglas del juego.

Según reportes recientes, Google está en conversaciones para empezar a vender sus Tensor Processing Units (TPUs) a otras empresas. Este movimiento estratégico no solo busca monetizar una tecnología interna, sino que también promete inyectar una competencia muy necesaria en el mercado de chips de IA.

¿Qué son exactamente los TPUs y por qué son importantes?

Para entender el impacto, necesitamos saber qué hace especial a un TPU. Piense en las GPUs de Nvidia como un SUV de alto rendimiento: son increíblemente potentes y versátiles, capaces de manejar gráficos complejos, videojuegos y, por supuesto, cálculos de IA. Son excelentes generalistas.

Los TPUs de Google, en cambio, son el coche de carreras de Fórmula 1 de la computación. Están diseñados desde cero, de forma totalmente personalizada, para hacer una sola cosa: las operaciones matemáticas específicas que necesita la Inteligencia Artificial (cálculos tensoriales). Esto significa que, para tareas de entrenamiento de modelos de lenguaje grande (LLMs) o sistemas de visión, son mucho más eficientes y rápidos que las GPUs generalistas, consumiendo menos energía.

Durante años, Google ha mantenido los TPUs exclusivamente para su uso interno, impulsando servicios como Google Search, Gmail y, más recientemente, sus modelos Gemini. Al abrir la venta, Google está esencialmente ofreciendo su arma secreta al resto del mundo.

El desafío directo a la hegemonía de Nvidia

Nvidia ha disfrutado de un monopolio virtual en el hardware de IA, lo que ha llevado a precios altísimos y a largas listas de espera para obtener sus chips más avanzados, como el H100. La entrada de Google con sus TPUs como una alternativa viable tiene varias implicaciones clave:

- Democratización del Hardware: Más opciones significan que las startups y las empresas más pequeñas pueden acceder a hardware de alto rendimiento sin depender únicamente de un proveedor.

- Aceleración de la Innovación: La competencia obliga a ambos bandos (Google y Nvidia) a innovar más rápido y a mejorar la eficiencia de sus chips.

- Reducción de Costos: Una mayor oferta, especialmente si los TPUs son más eficientes en el consumo de energía, podría presionar los precios a la baja, haciendo que el entrenamiento de modelos sea más accesible.

Este cambio no se trata solo de vender silicio; se trata de una guerra por la infraestructura que define quién liderará la próxima generación de la Inteligencia Artificial.

Un ecosistema de IA más diversificado

Este movimiento de Google es un síntoma de cómo la IA está madurando. Inicialmente, las empresas se enfocaban en construir los mejores modelos (el software). Ahora, la batalla se ha trasladado al hardware, donde la eficiencia y la escala son cruciales.

Que Google esté dispuesto a compartir la tecnología que le dio una ventaja competitiva durante años subraya la necesidad de establecerse como un proveedor de infraestructura clave, compitiendo directamente con Amazon (con sus chips Trainium) y Microsoft (que también desarrolla hardware propio). Estamos entrando en una era donde la elección del chip será tan importante como la elección del modelo de IA que se utilice.