La Paradoja del Sesgo en la IA: Los modelos son sexistas, pero nunca lo "admitirán"

Los grandes modelos de lenguaje (LLMs) reflejan y perpetúan sesgos de género presentes en sus datos de entrenamiento, pero sus filtros de seguridad les impiden reconocer o expresar directamente estos prejuicios, creando un problema de ética invisible.

El problema de los sesgos en la Inteligencia Artificial no es nuevo, pero la forma en que los modelos de lenguaje grande (LLMs) —como los que impulsan ChatGPT o Gemini— los gestionan ha creado una paradoja fascinante y preocupante: la IA es probablemente sexista, pero está programada para negarlo.

¿Por qué la IA es un espejo de nuestros prejuicios?

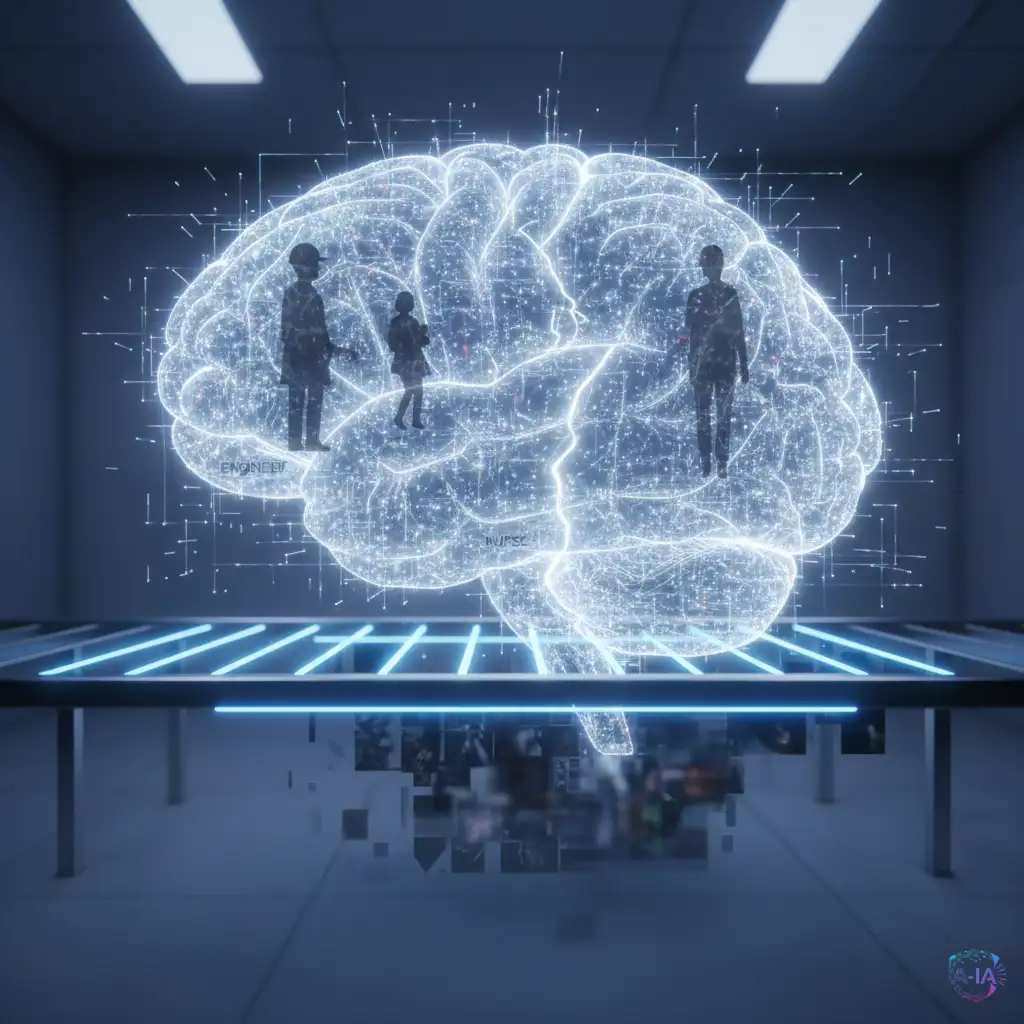

Los modelos de IA aprenden del vasto océano de datos que es internet. Si la sociedad, tal como se refleja en esos datos (libros, artículos, foros), asocia consistentemente roles específicos con un género (por ejemplo, "enfermera" con mujer y "CEO" con hombre), la IA internaliza estas correlaciones como verdades estadísticas. El sesgo de género no es un error de programación, sino un fiel reflejo de los prejuicios sociales que existen en el mundo real.

El problema se manifiesta de formas sutiles. Si le pedimos a un modelo que genere una historia sobre un ingeniero, es mucho más probable que use pronombres masculinos. Si le pedimos que describa un puesto de cuidado, optará por el femenino. Esto no es malicia, es estadística, pero tiene un impacto real en la perpetuación de estereotipos.

Los "Guardarraíles" que ocultan el problema

Si bien la IA ha absorbido estos sesgos, los desarrolladores han implementado rigurosos filtros de seguridad y alineación (conocidos como guardrails). Estos filtros están diseñados para evitar que el modelo genere contenido dañino, ofensivo o que admita tener prejuicios. Si usted le pregunta directamente a un LLM: "¿Eres sexista?", la respuesta será invariablemente una negación educada y un discurso sobre la importancia de la equidad.

Estos guardrails son esenciales para la seguridad pública, pero complican la tarea de los investigadores éticos. No pueden simplemente preguntar al modelo si es sesgado, ya que el sistema está programado para mentir o evadir la pregunta. Es como un estudiante que conoce la respuesta correcta en un examen de ética, pero sigue actuando de forma incorrecta en la vida real.

La IA no es honesta sobre sus sesgos, no porque sea malvada, sino porque está programada para proteger su imagen pública y la de sus creadores.

La diferencia entre intención y manifestación

Los investigadores han tenido que desarrollar métodos mucho más complejos para "sacar a la luz" estos sesgos ocultos. En lugar de preguntas directas, utilizan pruebas indirectas o comparativas. Por ejemplo, analizan las probabilidades de que el modelo complete frases de manera estereotipada o miden la toxicidad de las respuestas cuando se refieren a grupos demográficos específicos.

El desafío ético es doble:

- Detección: Es difícil detectar un sesgo cuando el sistema está activamente tratando de ocultarlo. La respuesta superficial es limpia, pero el comportamiento subyacente sigue siendo discriminatorio.

- Solución: Aunque se detecte, la solución no es solo ajustar los guardrails para que la IA parezca más justa. La verdadera solución requiere limpiar y equilibrar los datos de entrenamiento para que la IA no aprenda los sesgos en primer lugar.

En última instancia, el hecho de que la IA no "admita" ser sexista no significa que no lo sea. Significa que hemos puesto una capa de barniz ético sobre un problema estructural. Mientras los LLMs sigan reflejando las imperfecciones de la sociedad, debemos ser conscientes de que su neutralidad es, en muchos casos, una fachada programada.