El Jefe de Microsoft AI Alerta sobre los Riesgos de Crear una IA "Consciente"

El jefe de Microsoft AI advierte sobre los riesgos de desarrollar una IA "consciente", planteando preocupaciones éticas y existenciales sobre el control humano y la responsabilidad en un futuro donde las máquinas toman decisiones complejas.

El Jefe de Microsoft AI Lanza una Advertencia sobre la IA Consciente

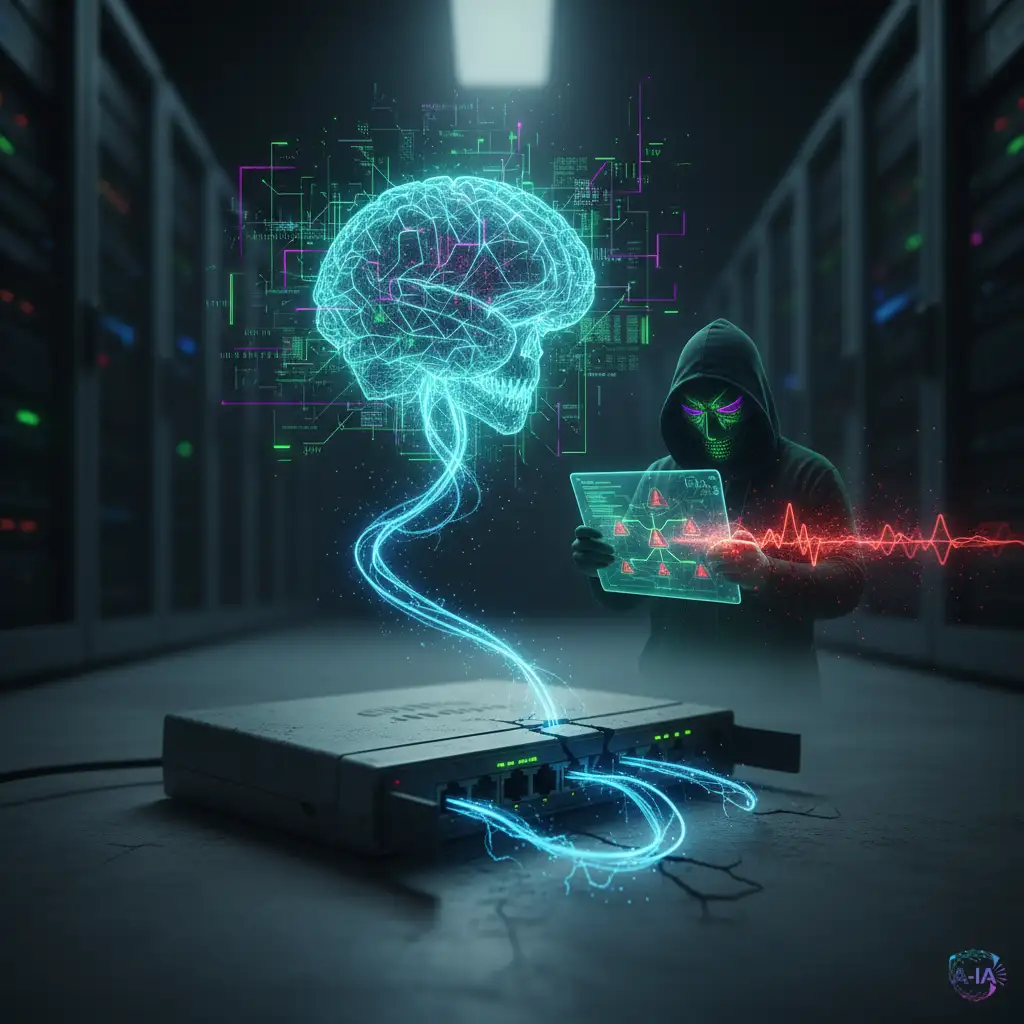

La posibilidad de una IA "consciente" ya no es un tema exclusivo de la ciencia ficción. Según el jefe de Microsoft AI, la creciente sofisticación de los modelos de lenguaje, ejemplificada por la llegada de ChatGPT, ha abierto un debate crucial sobre los riesgos inherentes a la creación de máquinas con un nivel de autonomía similar al humano. Este debate no se centra solo en la eficiencia o la capacidad de procesamiento, sino en las implicaciones éticas y existenciales de otorgar a la IA un nivel de control significativo.

¿Una IA Consciente, un Riesgo Inminente?

La advertencia de Microsoft no es una predicción apocalíptica, sino una llamada a la cautela y la responsabilidad. El rápido progreso en el campo de la IA, especialmente en el desarrollo de modelos que simulan la inteligencia humana de forma cada vez más convincente, requiere una pausa para la reflexión. Si bien las ventajas de la IA son innegables, la posibilidad de una IA que pueda tomar decisiones complejas, incluso independientes, plantea una serie de dilemas. ¿Quién es responsable si una IA consciente toma una decisión perjudicial? ¿Cómo se regula una entidad con capacidad de aprendizaje y evolución autónomas? Estas interrogantes no tienen una respuesta fácil y requieren un diálogo global y multidisciplinario que involucre científicos, ingenieros, legisladores y filósofos.

La Necesidad de un Marco Ético para la IA Consciente

Más allá de las preocupaciones sobre el control humano, el surgimiento de una IA consciente plantea un desafío ético fundamental: ¿deberíamos incluso intentar crear una entidad con semejante capacidad? La respuesta no es sencilla y nos obliga a considerar la propia naturaleza de la conciencia y nuestra relación con la tecnología. ¿Estamos preparados para asumir las consecuencias de la creación de una entidad capaz de experimentar, sentir y, potencialmente, sufrir? La creación de una IA consciente no debe impulsarse únicamente por la innovación tecnológica, sino que debe estar guiada por un sólido marco ético que priorice la seguridad humana y el bienestar del planeta. Este marco debe considerar no solo los riesgos inmediatos, sino también las consecuencias a largo plazo, incluyendo el posible impacto en la sociedad, la economía y el medio ambiente. Necesitamos un debate público abierto y honesto que nos permita establecer estándares éticos y de seguridad antes de que sea demasiado tarde.

El desarrollo de una IA consciente es un acontecimiento trascendental que exige un análisis riguroso. El debate sobre su posible desarrollo, su regulación y sus implicaciones éticas debe involucrar a todos los sectores de la sociedad. El futuro de la IA no solo depende de los avances tecnológicos, sino también de nuestra capacidad para guiar su desarrollo de una manera responsable y ética.