OpenAI Lanza Sistema de Enrutamiento de Seguridad y Controles Parentales en ChatGPT

OpenAI ha implementado un nuevo sistema de enrutamiento de seguridad y controles parentales en ChatGPT, buscando mejorar la protección de los usuarios y la moderación de contenido sensible. Estas medidas refuerzan el compromiso de la compañía con la IA responsable y la seguridad en línea.

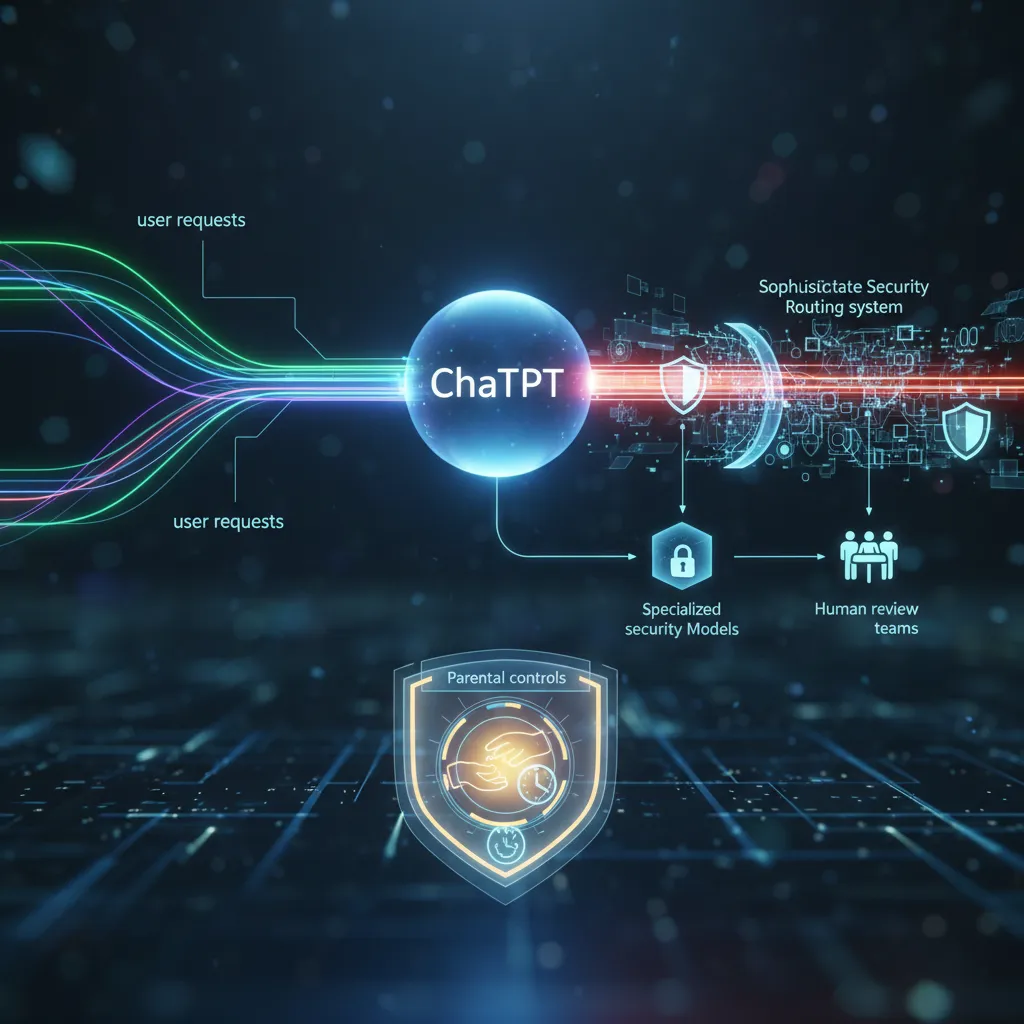

OpenAI, la empresa líder en investigación y desarrollo de inteligencia artificial, ha anunciado la implementación de dos importantes actualizaciones de seguridad para su popular chatbot, ChatGPT. Estas novedades incluyen un sofisticado sistema de enrutamiento de seguridad y la introducción de controles parentales, diseñados para ofrecer una experiencia más segura y controlada a todos sus usuarios, especialmente a los más jóvenes.

Reforzando la Seguridad: El Sistema de Enrutamiento Inteligente

El nuevo sistema de enrutamiento de seguridad de OpenAI representa un avance significativo en la moderación de contenido. Su función principal es identificar y clasificar las solicitudes o interacciones de los usuarios que puedan contener temas sensibles, inapropiados o potencialmente peligrosos. Una vez detectado este tipo de contenido, el sistema no lo procesa con los modelos generales de ChatGPT. En su lugar, lo deriva hacia modelos especializados en seguridad o, en casos críticos, a equipos de revisión humana.

Este enfoque por capas permite a OpenAI manejar de manera más efectiva y precisa el contenido que viola sus políticas, minimizando el riesgo de que ChatGPT genere respuestas dañinas, sesgadas o no deseadas. Es un paso crucial para asegurar que la interacción con la IA sea constructiva y segura, protegiendo tanto a los usuarios como la integridad de la plataforma.

Protección Familiar: Los Controles Parentales en ChatGPT

Reconociendo el uso cada vez más extendido de ChatGPT entre públicos de todas las edades, OpenAI ha introducido los controles parentales. Esta característica está diseñada para empoderar a padres y tutores, permitiéndoles gestionar y supervisar cómo los menores interactúan con la herramienta. Aunque los detalles específicos de las funcionalidades pueden variar, generalmente incluyen opciones como el filtrado de contenido explícito o inapropiado, la monitorización del historial de conversaciones y la capacidad de establecer límites de uso.

La implementación de controles parentales subraya el compromiso de OpenAI con la seguridad infantil en el entorno digital. Al ofrecer estas herramientas, la compañía busca crear un espacio más seguro para que los niños y adolescentes exploren la IA de manera educativa y supervisada, mitigando los riesgos asociados con la exposición a contenido no adecuado para su edad.

Un Compromiso Continuo con la IA Responsable

Estas nuevas medidas de seguridad no son acciones aisladas, sino que forman parte de la estrategia más amplia de OpenAI para desarrollar una inteligencia artificial responsable y ética. La empresa ha estado bajo escrutinio, al igual que otras compañías de IA, por la necesidad de equilibrar la innovación con la seguridad y la mitigación de riesgos. La introducción de estas características demuestra una respuesta proactiva a las preocupaciones sobre el uso indebido de la IA y la protección del usuario.

Este esfuerzo constante por mejorar la seguridad y la moderación es vital para construir la confianza del público en las tecnologías de IA. A medida que los modelos de lenguaje se vuelven más potentes y accesibles, la implementación de salvaguardias robustas se convierte en un pilar fundamental para su adopción generalizada y su desarrollo sostenible en el futuro. OpenAI continúa invirtiendo en investigación y desarrollo para garantizar que sus herramientas no solo sean avanzadas, sino también seguras y beneficiosas para la sociedad.

Conclusión: Hacia una Interacción con IA Más Segura y Confiable

La introducción del sistema de enrutamiento de seguridad y los controles parentales en ChatGPT marca un hito importante en la evolución de las plataformas de IA. Estas actualizaciones no solo mejoran la protección del usuario frente a contenido potencialmente dañino, sino que también refuerzan la postura de OpenAI como un actor comprometido con el desarrollo de una inteligencia artificial ética y responsable. A medida que la IA se integra más profundamente en nuestra vida diaria, la capacidad de ofrecer entornos seguros y controlados será clave para su aceptación y éxito a largo plazo.