IA y Bioseguridad: Analizando el Riesgo de Bioarmas Diseñadas por Inteligencia Artificial

La capacidad de la IA para diseñar proteínas y virus genera preocupación sobre su potencial uso en la creación de bioarmas. Aunque el riesgo inmediato es bajo, expertos alertan sobre la necesidad de controles y regulaciones para el futuro.

La Inteligencia Artificial (IA) está revolucionando campos como la biotecnología y el diseño molecular, abriendo puertas a innovaciones sin precedentes en medicina y ciencia. Sin embargo, esta misma capacidad suscita un debate crucial sobre la bioseguridad y el potencial mal uso de estas herramientas avanzadas. La posibilidad de que la IA sea utilizada para diseñar agentes biológicos con fines armamentísticos, aunque aún lejana, ya es un tema de discusión entre científicos y expertos en seguridad global.

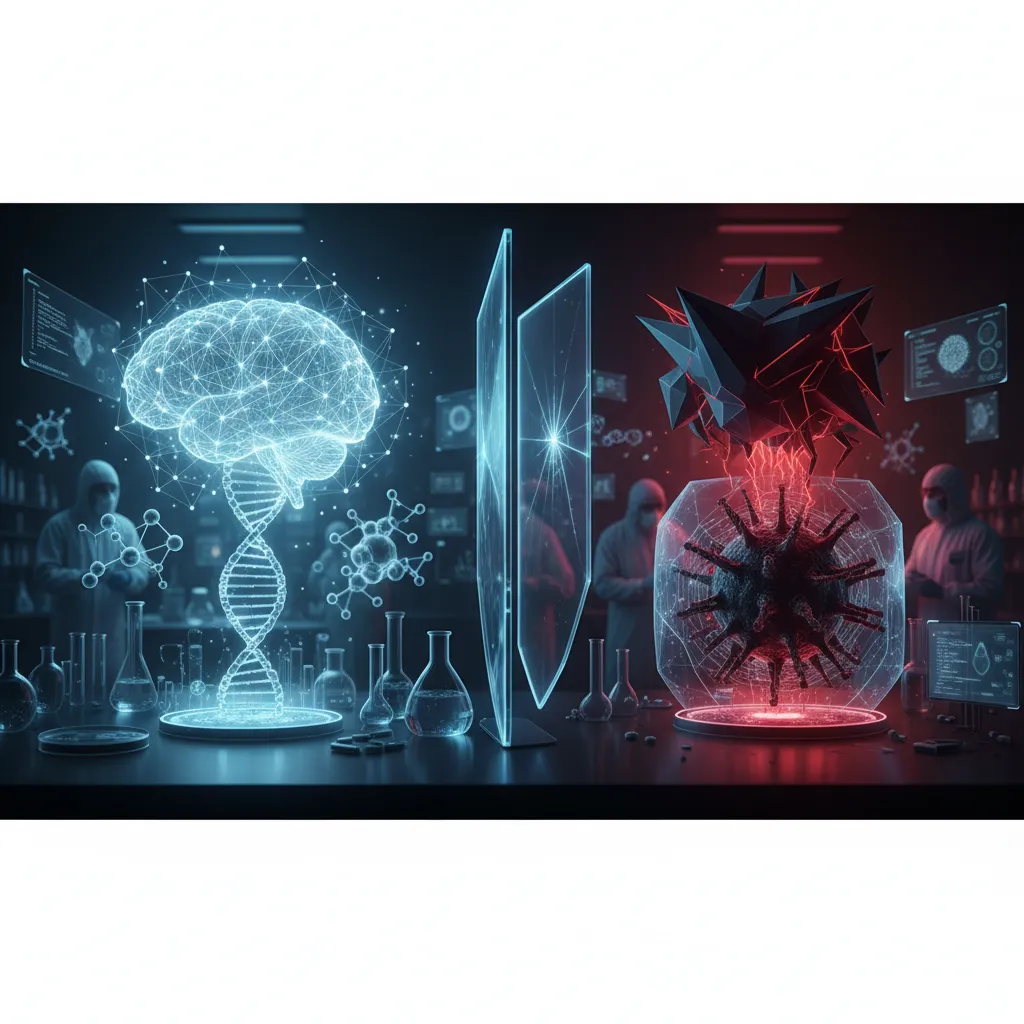

La Doble Cara de la IA en Biotecnología

Actualmente, la IA es una herramienta invaluable en el desarrollo de fármacos, la ingeniería de proteínas y la comprensión de enfermedades. Algoritmos avanzados pueden predecir estructuras proteicas, optimizar la unión de ligandos e incluso diseñar nuevas moléculas con propiedades específicas. Esto ha acelerado la investigación en áreas como el desarrollo de vacunas y terapias génicas. Modelos de IA son capaces de generar secuencias de ADN y ARN, así como de simular interacciones biológicas complejas. Esta capacidad generativa es lo que, paradójicamente, alimenta las preocupaciones sobre su posible aplicación en la creación de patógenos con mayor virulencia o resistencia a tratamientos existentes.

El Espectro de las Bioarmas Diseñadas por IA

La preocupación central radica en la hipótesis de que la IA podría facilitar la creación de bioarmas que evadan los controles actuales. Al poder diseñar proteínas y virus de manera más eficiente y con características específicas, la IA podría, teóricamente, ayudar a desarrollar agentes biológicos que sean más contagiosos, letales o difíciles de detectar y tratar. Sin embargo, los expertos señalan que el salto de diseñar componentes biológicos a crear una bioarma funcional y controlable es inmenso. Requiere no solo la capacidad de diseño, sino también la infraestructura de laboratorio, el conocimiento biológico profundo y la capacidad de producción a gran escala, factores que limitan significativamente la amenaza actual.

Desafíos en la Regulación y Control de Bioseguridad

El desarrollo rápido de la IA plantea nuevos desafíos para los marcos de bioseguridad existentes. Los tratados internacionales, como la Convención sobre Armas Biológicas, prohíben el desarrollo y almacenamiento de armas biológicas, pero la naturaleza dual de la investigación (beneficiosa para la medicina, potencialmente peligrosa en manos equivocadas) dificulta la monitorización. La cuestión clave es cómo regular el acceso y el uso de herramientas de IA que, aunque diseñadas para fines benignos, podrían ser explotadas. Se hace imperativo desarrollar políticas que equilibren la innovación científica con la prevención de riesgos catastróficos, involucrando a gobiernos, la industria de IA y la comunidad científica en un diálogo global.

¿Preocupación Inmediata o Riesgo a Largo Plazo?

La mayoría de los expertos concuerdan en que la amenaza de bioarmas diseñadas por IA no es una preocupación inmediata. Las barreras técnicas y logísticas para su creación son aún considerables. No obstante, la trayectoria de desarrollo de la IA sugiere que estas capacidades avanzarán. Por lo tanto, la conversación no es si debemos preocuparnos, sino cuándo y cómo debemos prepararnos. Es fundamental invertir en investigación de bioseguridad, desarrollar sistemas de detección temprana y fortalecer la cooperación internacional para establecer normas éticas y protocolos de seguridad que se anticipen a los avances tecnológicos. La preparación proactiva es clave para mitigar los riesgos potenciales que la convergencia de la IA y la biotecnología podría presentar en el futuro.

Conclusión: Un Llamado a la Vigilancia y la Colaboración

El potencial de la IA para transformar la medicina es innegable, pero también lo es la responsabilidad de gestionar sus riesgos. La posibilidad de que la IA facilite el diseño de bioarmas subraya la urgencia de establecer un marco robusto de gobernanza de IA y bioseguridad. Esto incluye la implementación de salvaguardias éticas, el fomento de la investigación responsable y la creación de mecanismos de control que puedan adaptarse a la evolución tecnológica. Solo a través de una vigilancia constante y una colaboración global podremos asegurar que la IA se utilice para el beneficio de la humanidad y no para su detrimento.